您好,我试了一下ceil算子,不开启NEUWARE_LOGINFO=1,CNML_PRINT_INFO=1也有runtime的算子不支持的报错信息,开启之后运行程序除了那个runtime错误,我好像也没发现有额外的算子信息的异常显示,那开启这些东西对于找程序中mlu不支持算子有什么作用吗?展开

全部回复

-

-

-

LV.2 #15 誓约回复#13andy_marvelous回复您好,我试了一下ceil算子,不开启NEUWARE_LOGINFO=1,CNML_PRINT_INFO=1也有runtime的算子不支持的报错信息,开启之后运行程序除了那个runtime错误,我好像也没发现有额外的算子信息的异常显示,那开启这些东西对于找程序中mlu不支持算子有什么作用吗?

您好,开启NEUWARE_LOGINFO=1 以及 CNML_PRINT_INFO=1后,运行您最开始贴的程序,并无任何报错。Unknown不作为报错信息。如果您想通过这两个环境变量查看不支持的算子,您可以尝试将input3_mlu语句替换为 input3_mlu = torch.ceil(input1_mlu) 即可观察到算子不支持的报错。即目前论坛上的cnml版本暂未支持ceil算子。

展开 -

LV.2 #14 誓约回复#13andy_marvelous回复您好,我运行的是一个网络模型推理的程序,我把推理的部分都放在了mlu上,能够推理成功,是不是就说明此程序没有mlu不支持的算子?这个程序的推理部分的所有算子都能跑在mlu上吗?

您好,开启NEUWARE_LOGINFO=1 以及 CNML_PRINT_INFO=1后,运行您最开始贴的程序,并无任何报错。Unknown不作为报错信息。如果您想通过这两个环境变量查看不支持的算子,您可以尝试将input3_mlu语句替换为 input3_mlu = torch.ceil(input1_mlu) 即可观察到算子不支持的报错。即目前论坛上的cnml版本暂未支持ceil算子。

展开 -

LV.2 #13 andy_marvelous回复#12誓约回复您好,开启NEUWARE_LOGINFO=1 以及 CNML_PRINT_INFO=1后,运行您最开始贴的程序,并无任何报错。Unknown不作为报错信息。如果您想通过这两个环境变量查看不支持的算子,您可以尝试将input3_mlu语句替换为 input3_mlu = torch.ceil(input1_mlu) 即可观察到算子不支持的报错。即目前论坛上的cnml版本暂未支持ceil算子。

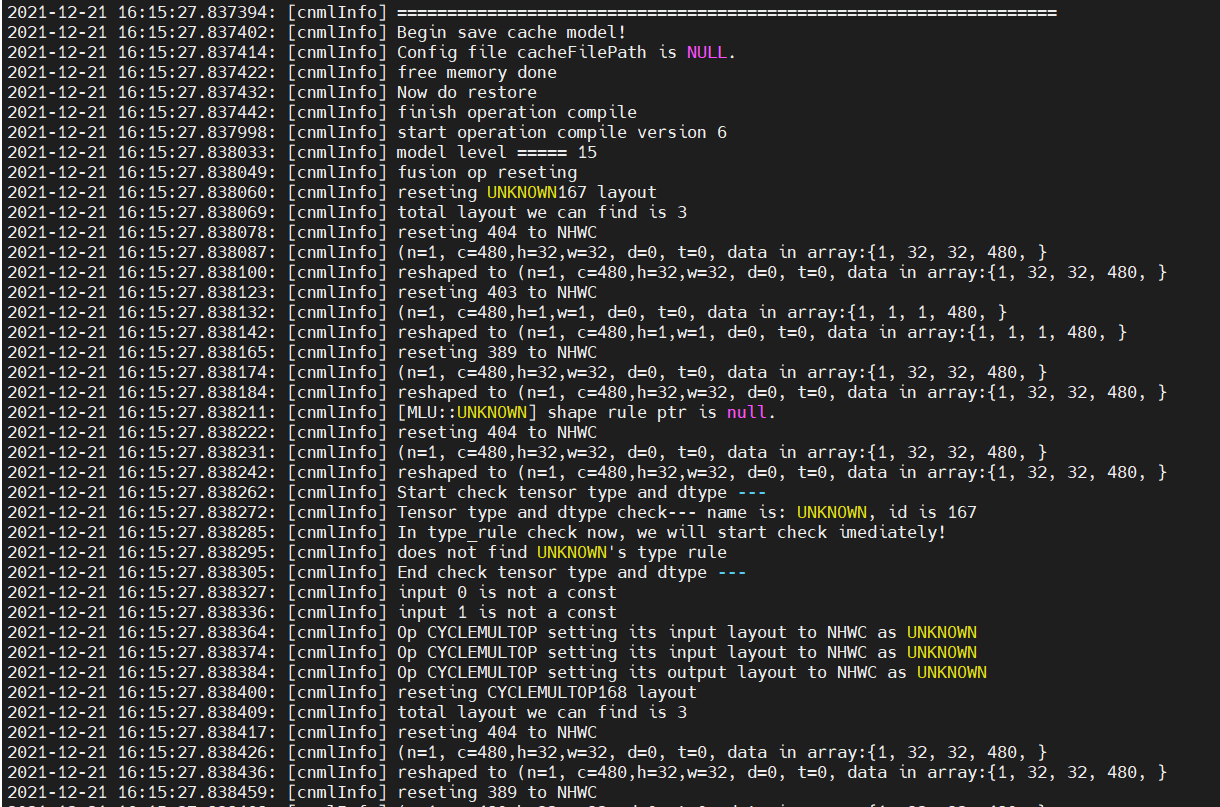

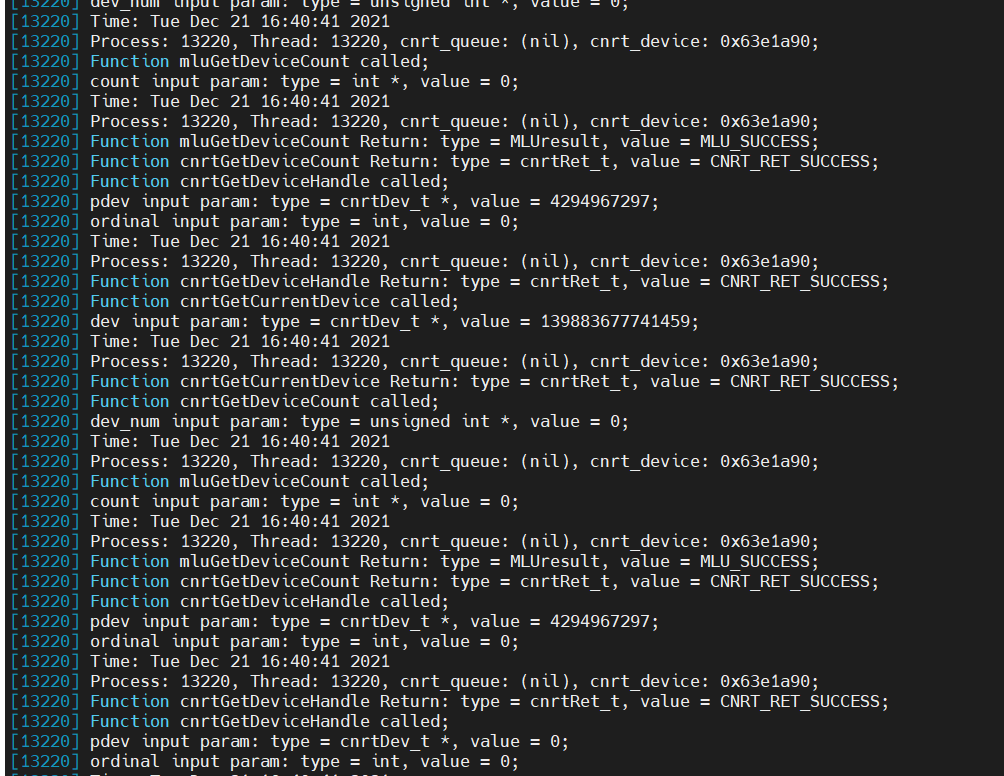

cnml返回的结果[图片]此图片中的Unknown·是代表不支持的算子吗?如果是下一步应如何定位呢?下面是NEUWARE_LOGINFO=1 返回的结果[图片]这个结果是要看value值来判断吗

展开 -

-

LV.2 #11 誓约回复#9andy_marvelous回复您好,我用NEUWARE_LOGINFO=1 和CNML_PRINT_INFO=1分别试了一下模型推理程序,请问如果遇到mlu不支持的算子,返回的信息是啥样的呢,如果找到这个返回信息要怎么才能定位到不支持的算子呢?我把返回的一些信息的图片放到此贴的评论里,请您看一下

您好: 1. 常见的加速方法有: (1). 使用融合模式 (2)参考《cnml用户手册》第8章(性能调优指南) 2. 算子调试方法:参考《cnml用户手册》,使用export NEUWARE_LOGINFO=1 或export CNML_PRINT_INFO=1,打印算子信息,若有mlu不支持的算子,则可通过打印信息看到。

展开 -

LV.2 #10 誓约回复#8andy_marvelous回复您好,首先十分感谢您的耐心解答,使我获益匪浅,对耽误的您的宝贵时间说声抱歉。我单步调试的原因是因为之前第一次单步调试报了cnml错误,但程序还可以继续运行,所以想一直试试这个单步调试,想找出错误的原因。现在我似乎已经懂了为什么报错的原因了,再次感谢您的耐心解答。

您好: 1. 使用pdb的n 命令调试,可顺利运行,使用s 命令调试也并未复现您的报错信息,另外,使用s命令是进入到函数语句的内部,使用n命令是不进入函数语句内部,请问您现在想使用单步调试的目的是? 2. 由于使用mlu进行异构计算,包含数据的host to device ,device to host 操作,且mlu需要进行设备初始化等操作,因此,如果运算任务相对简单,则实际运算耗时相对较少,host to device ,device to host 操作以及mlu设备初始化等操作的耗时相对较多,因此导致总体耗时较大。若使用mlu进行更为复杂的运算,例如运行yolo系列网络,则运算耗时相比于mlu初始化耗时会更大,由此方可体现mlu的计算速度。

展开 -

LV.2 #9 andy_marvelous回复#5誓约回复您好: 1. 常见的加速方法有: (1). 使用融合模式 (2)参考《cnml用户手册》第8章(性能调优指南) 2. 算子调试方法:参考《cnml用户手册》,使用export NEUWARE_LOGINFO=1 或export CNML_PRINT_INFO=1,打印算子信息,若有mlu不支持的算子,则可通过打印信息看到。

好的,谢谢您,我现在用某个网络在mlu上推理一张图片,能够推理成功,程序运行无错,但是速度很慢,请问我该如何加速呢,我准备直接从写bang C算子入手,请问有什么便捷的方法可以找出我运行的这个网络中哪些算子没有在mlu上跑和哪些算子不能在mlu上跑呢?

展开 -

LV.2 #8 andy_marvelous回复#6誓约回复您好: 1. 使用pdb的n 命令调试,可顺利运行,使用s 命令调试也并未复现您的报错信息,另外,使用s命令是进入到函数语句的内部,使用n命令是不进入函数语句内部,请问您现在想使用单步调试的目的是? 2. 由于使用mlu进行异构计算,包含数据的host to device ,device to host 操作,且mlu需要进行设备初始化等操作,因此,如果运算任务相对简单,则实际运算耗时相对较少,host to device ,device to host 操作以及mlu设备初始化等操作的耗时相对较多,因此导致总体耗时较大。若使用mlu进行更为复杂的运算,例如运行yolo系列网络,则运算耗时相比于mlu初始化耗时会更大,由此方可体现mlu的计算速度。

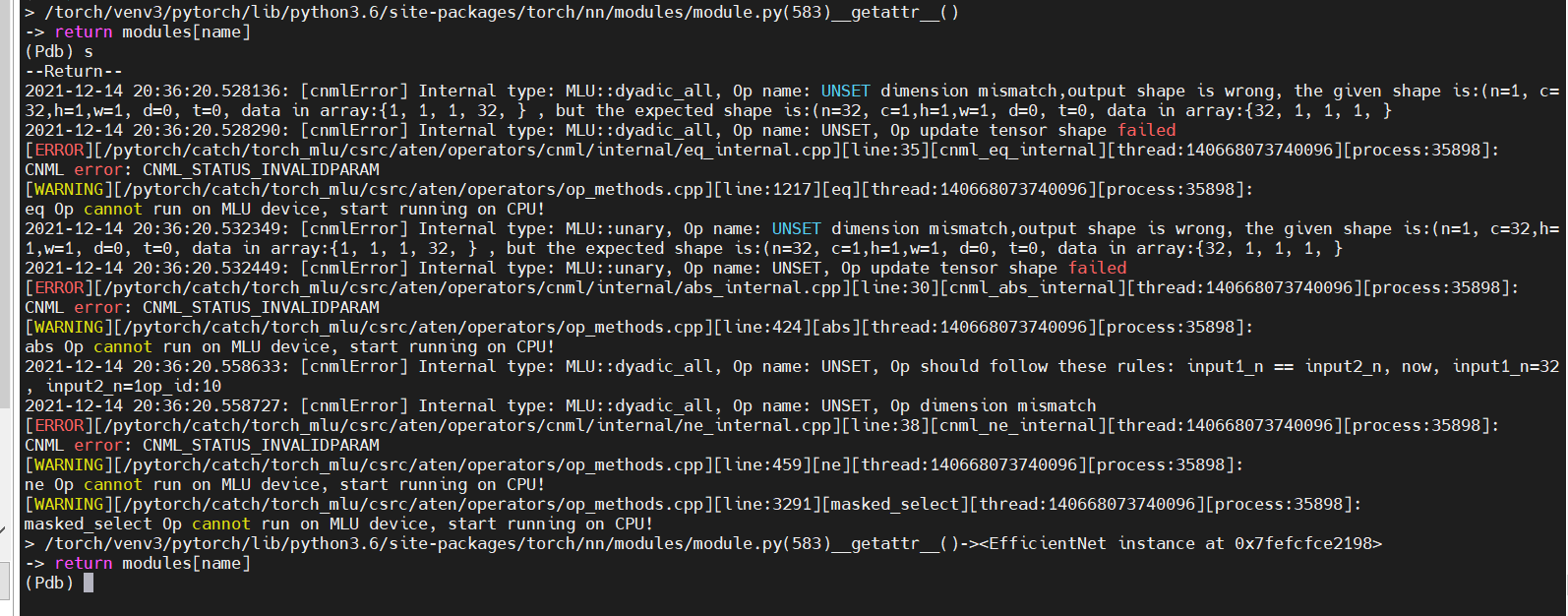

您好,我用pdb的s命令调试我写的模型推理的程序还是报错了,我发现一直是abs,ne,eq,masks_select这几个算子,而且还伴有cnml错误,不调试直接运行程序没有问题,但是运行的很慢,比在cpu上慢,这是怎么回事呢?

展开 -

-

-

-

LV.2 #4 andy_marvelous回复#3誓约回复您好,建议您直接在服务器终端使用pdb 进行调试。mlu上使用cat,slice等算子的调用方式与cuda 类似,您贴的程序示例便体现了如何在mlu上调用cat slice算子

您好,我调试的方式是在vscode上单步调试的,使用的是mlu270,如果不调试直接运行的话不报错误,,但是在vscode使用默认的调试文件进行单步调试就会报上面的错误和警告,是我的环境变量没配好吗?还是我的调试配置文件没配好?还是不能像我的那种方式进行调试呢? 还有一个问题想问您,在mlu环境上使用cat,slice等算子的调用方式和在pytorch+cuda里调用算子的写法是一样的吗?或者说两种机器上的算子里面传入的参数是一样的吗?

展开 -

LV.2 #3 誓约回复#1andy_marvelous回复您好,我调试的方式是在vscode上单步调试的,使用的是mlu270,如果不调试直接运行的话不报错误,,但是在vscode使用默认的调试文件进行单步调试就会报上面的错误和警告,是我的环境变量没配好吗?还是我的调试配置文件没配好?还是不能像我的那种方式进行调试呢? 还有一个问题想问您,在mlu环境上使用cat,slice等算子的调用方式和在pytorch+cuda里调用算子的写法是一样的吗?或者说两种机器上的算子里面传入的参数是一样的吗?

您好,已在本地运行该段代码,可以顺利产出推理结果,无报错信息。请问您这边的环境是?目前是单步调试的时候出错吗?

展开 -

-

请登录后评论