你好,如何判断模型是否符合及设置参数,请问有没有具体的文档?

-

-

-

LV.1 #8 老黄牛回复#6xulwang回复

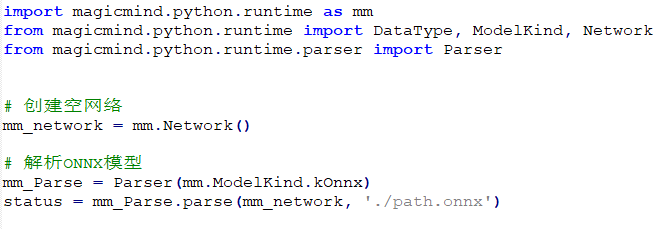

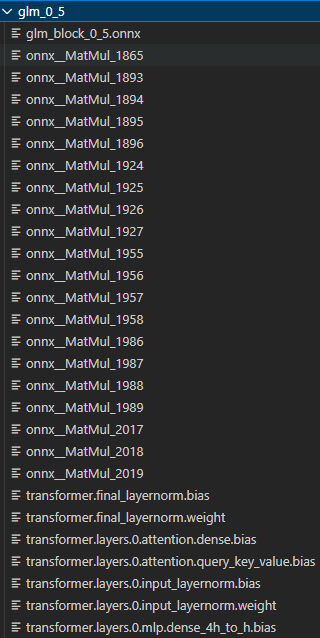

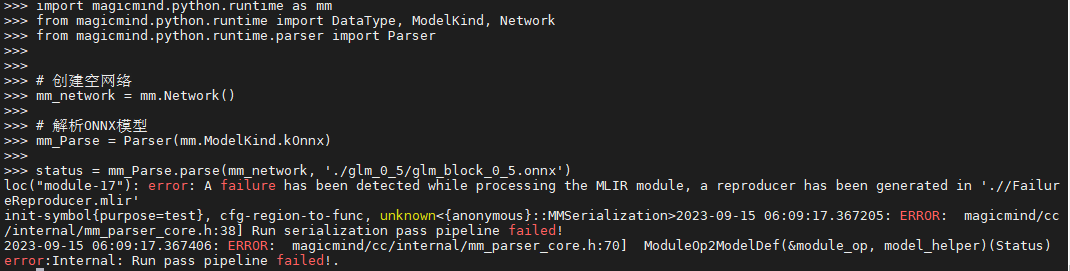

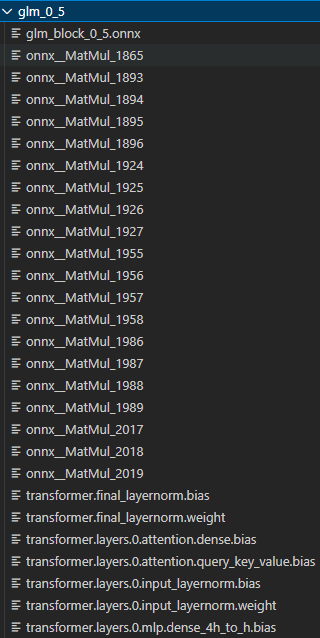

你好,我按照示例中的步骤 https://developer.cambricon.com/index/curriculum/details/id/43/classid/7.html 尝试使用python接口来转换模型, 在使用magicmind.python.runtime.parser.Parser接口对onnx模型进行解析时报错,错误信息与onnx_build错误一致,看起来多个文件的onnx模型并未被解析成功。请问Parser 也暂不支持解析有多个文件的ONNX模型吗?以下是代码:[图片]以下是模型文件:[图片]以下是错误日志:[图片]

展开看下外部模型是否符合External Data, 然后设置onnx-external-data-dir参数试下

-

LV.1 #7 xulwang回复#6xulwang回复

你好,我按照示例中的步骤 https://developer.cambricon.com/index/curriculum/details/id/43/classid/7.html 尝试使用python接口来转换模型, 在使用magicmind.python.runtime.parser.Parser接口对onnx模型进行解析时报错,错误信息与onnx_build错误一致,看起来多个文件的onnx模型并未被解析成功。请问Parser 也暂不支持解析有多个文件的ONNX模型吗?以下是代码:[图片]以下是模型文件:[图片]以下是错误日志:[图片]

展开上条回复中部分描述被遮挡,完整的描述是:

你好,我按照示例中的步骤 https://developer.cambricon.com/index/curriculum/details/id/43/classid/7.html 尝试使用python接口来转换模型,在使用magicmind.python.runtime.parser.Parser 接口对onnx模型进行解析时报错,错误信息与onnx_build错误一致,看起来多个文件的onnx模型并未被解析成功。

请问Parser 也不支持解析有多个文件的ONNX模型吗?

-

LV.1 #6 xulwang回复#5老黄牛回复

请参考使用手册,这种情况建议使用python接口来转模型,onnx_build目前还不支持这种情况的转换。http://docview.cambricon.com/projects/magicmind/user_guide/9_import_framework_model/import_framework_model.html#id62

展开你好,我按照示例中的步骤 https://developer.cambricon.com/index/curriculum/details/id/43/classid/7.html 尝试使用python接口来转换模型, 在使用magicmind.python.runtime.parser.Parser接口对onnx模型进行解析时报错,错误信息与onnx_build错误一致,看起来多个文件的onnx模型并未被解析成功。

请问Parser 也暂不支持解析有多个文件的ONNX模型吗?

以下是代码:

以下是模型文件:

以下是错误日志:

-

-

-

LV.1 #3 逍遥_李秋水回复#2xulwang回复chatglm 6B 建议使用 pytorch 框架运行哈

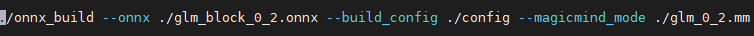

您好,我用的模型是ChatGLM-6B,模型有28层transformer,fp32格式模型文件大约有22G。单个ONNX模型文件似乎有2GB大小的限制,更大的 ONNX 模型将被拆分成许多的文件碎片保存。 因此当我使用pytorch将多个层转换为一个ONNX模型时我会得到多个文件,如图中所示。[图片]可以使用转换工具将有多个文件碎片的ONNX模型转换为magicmind模型吗。 onnx导出magicmind命令如下(实际只将opt_config的type64to32_conversion参数设为True,其他都是默认项):[图片]config文件内容如下:[图片]

展开 -

LV.1 #2 xulwang回复#1逍遥_李秋水回复

您好,导出onnx通常是导出一个模型哈,您是用的什么模型,导出的参数配置是?

您好,我用的模型是ChatGLM-6B,模型有28层transformer,fp32格式模型文件大约有22G。单个ONNX模型文件似乎有2GB大小的限制,更大的 ONNX 模型将被拆分成许多的文件碎片保存。 因此当我使用pytorch将多个层转换为一个ONNX模型时我会得到多个文件,如图中所示。

可以使用转换工具将有多个文件碎片的ONNX模型转换为magicmind模型吗。

onnx导出magicmind命令如下(实际只将opt_config的type64to32_conversion参数设为True,其他都是默认项):

config文件内容如下:

-

请登录后评论