谢谢指导,第一个问题完美解决!对于第二个问题,是不是可以理解为可以进行推理时我可以自由选择整型或浮点型的计算方式(在不考虑计算效率时),还是此时的推理一定是在量化模式下?展开

全部回复

-

-

LV.1 #5 liyong回复#2tanhaojue回复你好,我把MLU270设置的是单核,但是仍然是没有东西输出,是否跟pytorch版本有关系吗?我yolov5s训练使用的pytorch1.4,neuware的环境是pytorch1.3,

您好,对于您的问题有以下两点说明: 1.多核的时候确实存在这个问题,正在解决中。可以设置core_number为1,单核运行融合模型是没问题的。 2.打印yolov5s_int16.pt,会发现只是模型的参数里增加了两个量化参数scale,quantized_mode。而实际上权重还是float,在推理时才会对其进行量化操作。

展开 -

-

-

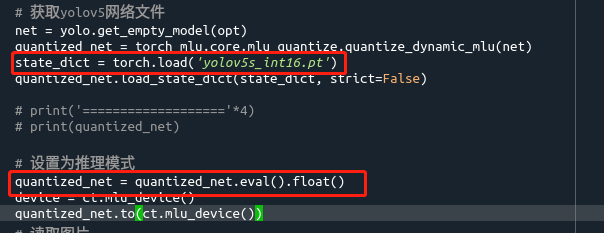

LV.2 #2 tanhaojue回复#1ygest回复您好,对于您的问题有以下两点说明: 1.多核的时候确实存在这个问题,正在解决中。可以设置core_number为1,单核运行融合模型是没问题的。 2.打印yolov5s_int16.pt,会发现只是模型的参数里增加了两个量化参数scale,quantized_mode。而实际上权重还是float,在推理时才会对其进行量化操作。

我参照的是参照“PyTorch框架的Yolov5移植教程”,其中模型导入的参数是int16,模型推理时又设置为float(),那么模型推理时运行的是整数参数还是浮点型参数?[图片]

展开 -

请登录后评论