您好,不好意思,我最近的几个问题是针对yolov7这个模型,我可能表达的不清楚,同样也是这个开发者的代码(https://gitee.com/smyai/yolov7),用这个代码生成的220模型在220上运行异常,没有框输出(结果如下图)[图片]还有一个问题就是fastestdet的前后处理c++代码您那边能提供一下吗,谢谢展开

-

-

LV.1 #25 lcxzzz回复#24hellokitty回复

您好,我们在MLU220-M.2的环境,运行了这位开发者提供的示例:“https://gitee.com/smyai/fastest-det”用MLU220-M.2进行在线融合推理,结果是正确的,没有异常问题请确认以下几点:1)使用的是MLU220-M.2吗?MLU220-M.2的环境能否支持使用寒武纪的pytorch-docker,若能支持,请运行下MLU220的融合推理结果是否正确;如果MLU220的融合推理结果正确,那请排查下220使用的离线推理代码;2)yolov5s的离线推理代码应该是不能直接套用的,您需要根据fastest-det的前后处理来进行修改;将fastest-det的python前后处理改写为c++;

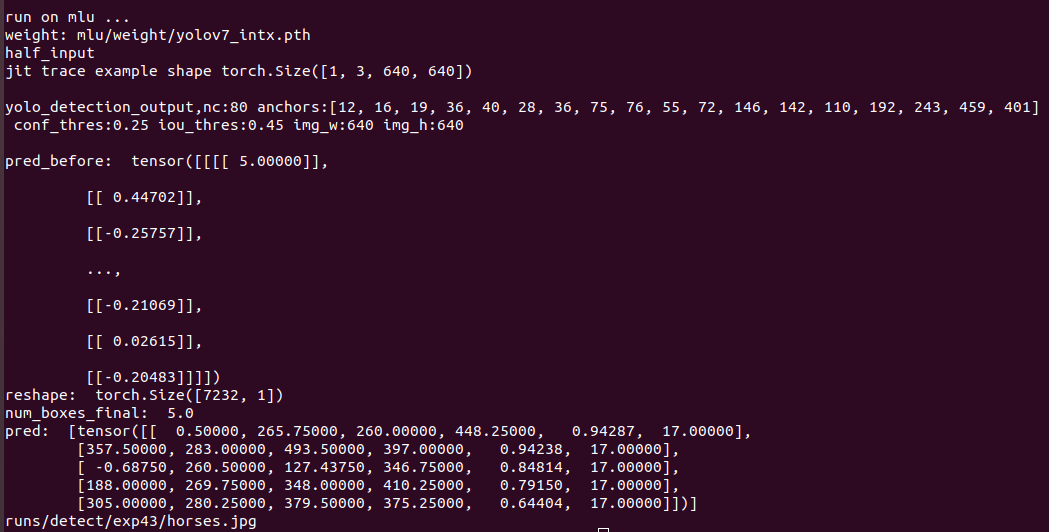

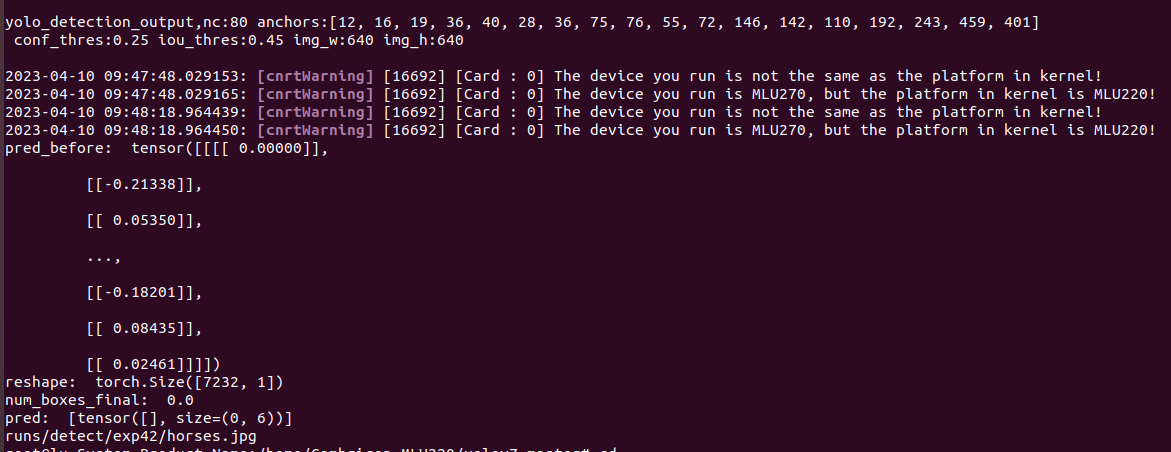

展开您好,不好意思,我最近的几个问题是针对yolov7这个模型,我可能表达的不清楚,同样也是这个开发者的代码(https://gitee.com/smyai/yolov7),用这个代码生成的220模型在220上运行异常,没有框输出(结果如下图)

还有一个问题就是fastestdet的前后处理c++代码您那边能提供一下吗,谢谢

-

LV.1 #24 hellokitty回复#23lcxzzz回复

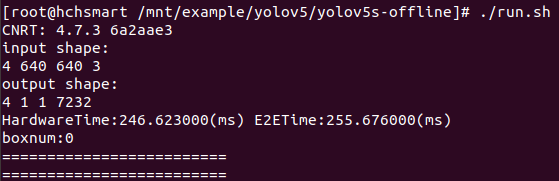

你好,我就是在270上生成的220离线模型,生成220版本都会报图中所示的warning,关于离线部分代码我使用的是yolov5s,下图是在220运行结果[图片]

展开您好,我们在MLU220-M.2的环境,运行了这位开发者提供的示例:“https://gitee.com/smyai/fastest-det”

用MLU220-M.2进行在线融合推理,结果是正确的,没有异常问题

请确认以下几点:

1)使用的是MLU220-M.2吗?MLU220-M.2的环境能否支持使用寒武纪的pytorch-docker,若能支持,请运行下MLU220的融合推理结果是否正确;

如果MLU220的融合推理结果正确,那请排查下220使用的离线推理代码;

2)yolov5s的离线推理代码应该是不能直接套用的,您需要根据fastest-det的前后处理来进行修改;将fastest-det的python前后处理改写为c++;

-

LV.1 #23 lcxzzz回复#22hellokitty回复

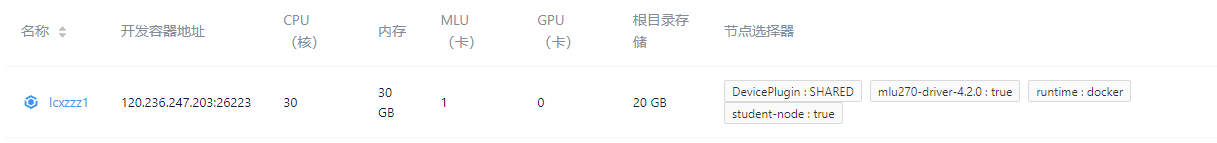

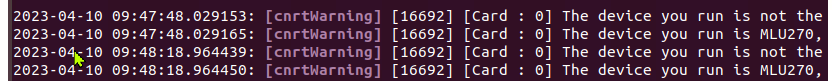

您好,请确认下您使用的硬件平台,您是在270卡上,跑220的离线模型吗?截图中这个报错,请完整截图,看起来是在270上跑的220的模型[图片]如果您需要移植模型在220上推理,顺序应如下:1)模型量化;2)270平台上融合验证结果;3)270平台上生成270的离线模型;验证270离线推理结果;4)270平台上生成220的离线模型;4)在220卡上运行220的离线模型;不能在270卡上跑220的离线模型,270上只能跑270的离线模型

展开你好,我就是在270上生成的220离线模型,生成220版本都会报图中所示的warning,关于离线部分代码我使用的是yolov5s,下图是在220运行结果

-

LV.1 #22 hellokitty回复#21lcxzzz回复

您好,270在线融合结果是正确的,但是设置成220后,发现框就丢失了,融合结果异常,可能是量化移植出错了,您那边yolov7能否在220上运行成功呢?[图片][图片]c++代码输出维度没有问题,同样也是在后处理端丢失目标框

展开您好,请确认下您使用的硬件平台,您是在270卡上,跑220的离线模型吗?

截图中这个报错,请完整截图,看起来是在270上跑的220的模型

如果您需要移植模型在220上推理,顺序应如下:

1)模型量化;2)270平台上融合验证结果;3)270平台上生成270的离线模型;验证270离线推理结果;4)270平台上生成220的离线模型;4)在220卡上运行220的离线模型;

不能在270卡上跑220的离线模型,270上只能跑270的离线模型

-

-

-

-

LV.1 #18 hellokitty回复#16lcxzzz回复

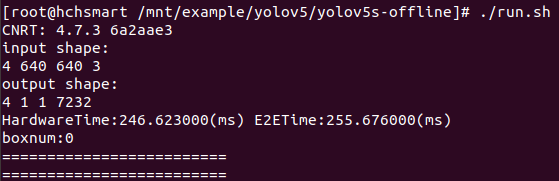

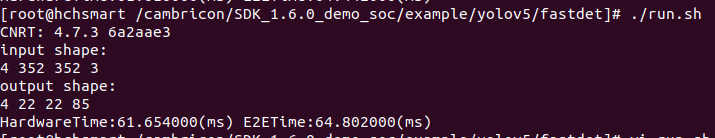

你好,(1)我使用的你们提供的fastdet代码生成离线模型在220上运行,融合阶段batch设置的是1,但是在220运行是input_shape的batch是4,如下图[图片](2)220上325x523输入hardtime的是61.50ms,我对比的网络是yolov5s,640x640图片,hardtime是66.41ms,为什么fastdet参数量和计算量小很多,但是hardtime只降低了一点谢谢!

展开“220上325x523输入hardtime的是61.50ms”

尽管输入尺寸小于yolov5,但两个模型结构不同,算子融合后的推理性能是存在差异的;

-

LV.1 #17 hellokitty回复#16lcxzzz回复

你好,(1)我使用的你们提供的fastdet代码生成离线模型在220上运行,融合阶段batch设置的是1,但是在220运行是input_shape的batch是4,如下图[图片](2)220上325x523输入hardtime的是61.50ms,我对比的网络是yolov5s,640x640图片,hardtime是66.41ms,为什么fastdet参数量和计算量小很多,但是hardtime只降低了一点谢谢!

展开您好,

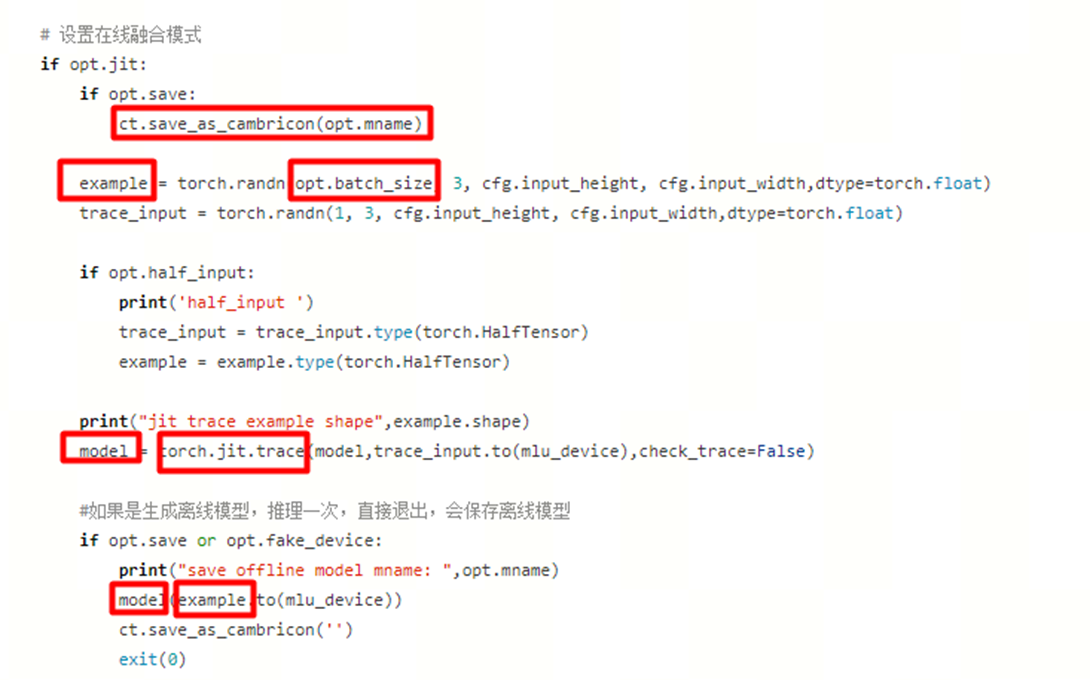

1)离线模型的输入batchsize,是在调用生成离线的接口后,由融合后网络推理时的输入batchsize决定的;以这位开发者提供的代码为例“https://gitee.com/smyai/fastest-det”

离线模型的batchsize是有example的batchsize决定的

-

LV.1 #16 lcxzzz回复#15hellokitty回复

请明确下您的问题:1)“220上输出的input_shape batch是4",是指什么?生成的220离线模型的输入batch?生成离线模型的输入batch是在调用生成离线接口后,由trace_model推理时给定的输入batch_size决定的,是可以根据需要变更的;2)“fastdet推理时间久”是同谁比较?不同的模型结构不同,推理性能是存在差异的

展开你好,

(1)我使用的你们提供的fastdet代码生成离线模型在220上运行,融合阶段batch设置的是1,但是在220运行是input_shape的batch是4,如下图

(2)220上325x523输入hardtime的是61.50ms,我对比的网络是yolov5s,640x640图片,hardtime是66.41ms,为什么fastdet参数量和计算量小很多,但是hardtime只降低了一点

谢谢!

-

LV.1 #15 hellokitty回复#14lcxzzz回复

您好,在220上移植出现了一下问题(1)fastdet在220上运行时输出的input_shape的batch的值是4,不是1。(2)fastdet的hardtime是61.65ms,而yolov5是66.41ms,为什么fastdet的推理时间这么久,是因为有模块没有加速吗?

展开请明确下您的问题:

1)“220上输出的input_shape batch是4",是指什么?生成的220离线模型的输入batch?生成离线模型的输入batch是在调用生成离线接口后,由trace_model推理时给定的输入batch_size决定的,是可以根据需要变更的;

2)“fastdet推理时间久”是同谁比较?不同的模型结构不同,推理性能是存在差异的

-

-

-

-

LV.1 #11 hellokitty回复#10lcxzzz回复

您好,我刚使用了寒武纪的开发容器,未找到docker-pytorch,请问寒武纪的开发容器是否提供docker-pytorch,是的话麻烦您指导一下怎么操作,让我这边先检测一下是否是环境问题导致的融合失败,谢谢!

展开您之前使用的容器就是pytorch-docker,但版本太旧了

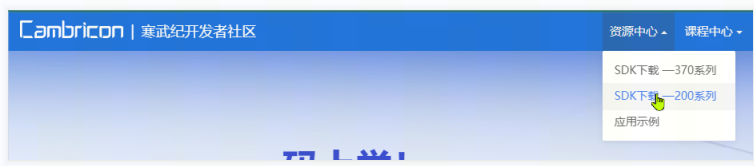

请在https://developer.cambricon.com/,下载200系列中的cambricon-pytorch docker镜像如下图所示

-

-

LV.1 #9 hellokitty回复#8lcxzzz回复

我看这边docker显示是v.1.6.0版本,请问这个版本没法运行吗?

您好,建议您升级下pytorch-docker版本

可以参考开发者社区:https://developer.cambricon.com/

获取相应SDK下载 -

-

请登录后评论