quantized_mode=None 只是量化模式参数(使用的是int8量化或是int16量化等)没有记录在模型里,只要您顺利生成量化模型,就不影响后续推理,可以忽略;此外,我注意到您代码里[代码]这段qconfig_spec=None可以由None改为qconfig,否则上面设置的config参数是没有生效的。展开

全部回复

-

-

-

LV.2 #8 xgs0705回复#7zhangyanting回复

好的,谢谢。qconfig_spec=None这个应该不影响量化模型的生成,我使用同样的代码量化yolov2/3/5都没什么问题,请问您那边知道为什么量化yolact模型会报这样的错吗?

-

LV.3 #7 zhangyanting回复#6xgs0705回复

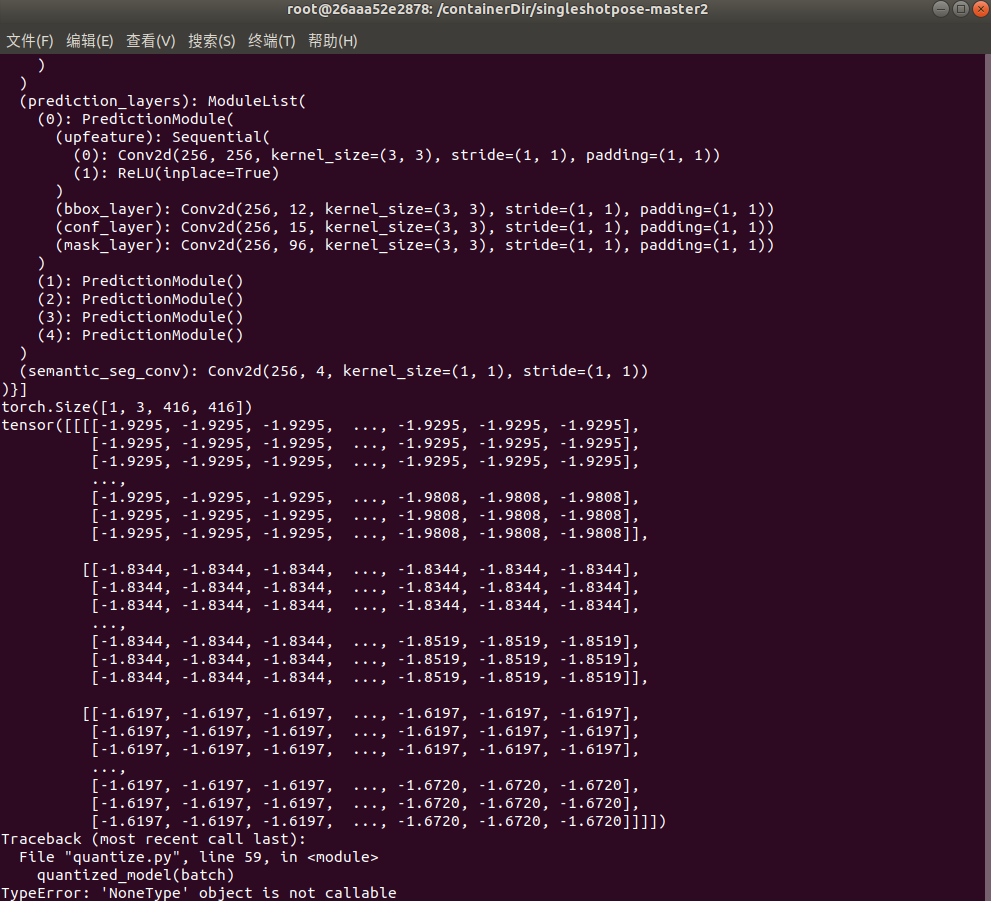

[图片]quantize_model.txt另外,我将量化得到的quantize_model打印出来了,打印结果如附件!可以看到算子已经做了替换,但是里面的quantize mode = none是怎么回事?求教,谢谢!

展开quantized_mode=None 只是量化模式参数(使用的是int8量化或是int16量化等)没有记录在模型里,只要您顺利生成量化模型,就不影响后续推理,可以忽略;此外,我注意到您代码里

qconfig={'iteration': 1, 'use_avg':False, 'data_scale':1.0, 'firstconv':False, 'per_channel': False} quantized_model = mlu_quantize.quantize_dynamic_mlu(yolact_net,qconfig_spec=None, dtype='int8', gen_quant=True)这段qconfig_spec=None可以由None改为qconfig,否则上面设置的config参数是没有生效的。

-

LV.2 #6 xgs0705回复#3zhangyanting回复

您好,麻烦提供一下yolact-mlu.pth和000086.png,以方便我们复现问题,谢谢!

另外,我将量化得到的quantize_model打印出来了,打印结果如附件!可以看到算子已经做了替换,但是里面的quantize mode = none是怎么回事?求教,谢谢!

-

-

LV.2 #4 xgs0705回复#3zhangyanting回复

您好,麻烦提供一下yolact-mlu.pth和000086.png,以方便我们复现问题,谢谢!

好的,多谢!

权重发不上来,我传到百度网盘上,您那边下载一下,谢谢!链接: 提取码: irus

-

-

-

请登录后评论