打开微信,使用扫一扫进入页面后,点击右上角菜单,

点击“发送给朋友”或“分享到朋友圈”完成分享

1. 实验设计:

实验一:BANGC算子实现

(1)必做题:实现风格迁移相关算子PowerDifference

(2)选做题:以下算子4选1

Softmax

Cosine相似度

Batch Normalization

Triplet Loss

实验二: TensorFlow集成与风格迁移实现

2. 实验环境

课程的实验环节免费提供云平台资源与实践教程,手把手帮助大家在动手实操的过程中真正理解如何充分利用DLP硬件特性来开发高性能算子,以及软件栈如何调用算子以完成深度学习算法在硬件上的执行。

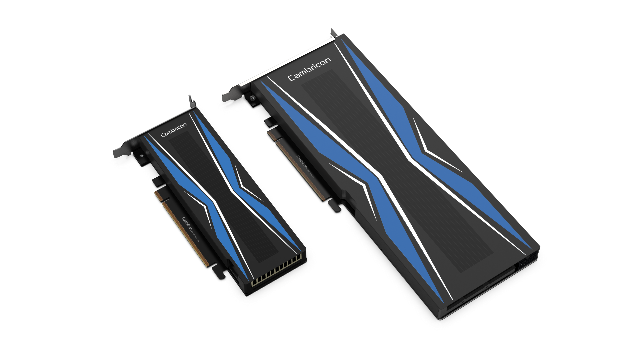

智能处理卡MLU100®

MLU100智能处理卡是寒武纪推出的第一款通用智能处理卡,为云端推理提供强大的算力支撑。

MLU100智能处理卡搭载了世界上第一款专门针对神经网络计算而设计的人工智能处理器—寒武纪MLU(Machine Learning Unit)100芯片。

MLU100智能处理卡在处理人工智能任务时可获得巨大的性能功耗比提升,是真正适合人工智能的处理器。

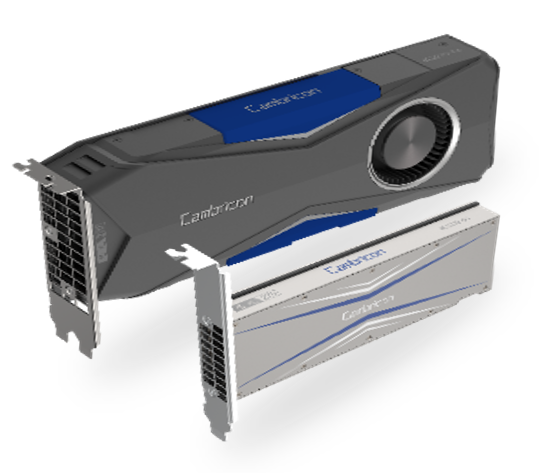

智能处理卡思元270(MLU270)

全新寒武纪MLUv02架构;

面向不同应用的最佳计算精度,支持INT16, INT8, INT4, FP32, FP16多种精度;

同精度稠密网络推理性能提升4倍,功耗维持不变;

片内集成硬件编解码器,加速智能视频、图片AI处理性能。

3. 如何上手实验?

(1)关注b站“智能计算系统AICS”,实验一教学讲解内容请看频道“实验一BangC算子实现”,实验二教学讲解内容请看频道“实验二TF集成与风格迁移实现”

(2)配合教学视频,下载下列实验文件,包含:

* 参考考核标准(供各位开发者们自查):

参考分数 | 标准 |

60≤x<70 | 完成 PowerDifference BCL 算子的基本实现以及基于 CNRT 的测 试,在测试数据中精度误差在1%以内,延时在100ms 以内 |

70≤x<80 | 在 60 分的基础上,CNRT 精度误差在 0.1%以内,延时在 50ms 以 内 |

80≤x<90 | 在 70 分的基础上,完成 TensorFlow 的算子集成,包括 cnplugin 集成与 TensorFlow 的编译;补全 python CPU、MLU 单算子测试程序(测试 数据与 CNRT 测试不同,规模更大-256*256*3)。使用 python 在 CPU 端精度 误差在 0.1%以内,延时不做要求;在 MLU 端精度误差在 10%以内,平均延时 在 50ms 以内 |

90≤x<100 | 在 80 分基础上,使用 python 在 MLU 端测试大规模数据时 (256*256*3)精度误差在 1%以内,平均延时在 50ms 以内(提示:BangC 中 需要使用多核拆分计算) |

满分100 | 在 90 分基础上,使用 python 在 MLU 端测试超大规模数据时(例 如 256*256*16、512*512*32 且幂指数大于 2)精度误差在 0.1%以内,延时 显著优于 CPU。 |

更多实验过程中遇到的问题,欢迎大家移步“实验支持”交流专区分享实验心得、查询技术问题等。

热门帖子

精华帖子