打开微信,使用扫一扫进入页面后,点击右上角菜单,

点击“发送给朋友”或“分享到朋友圈”完成分享

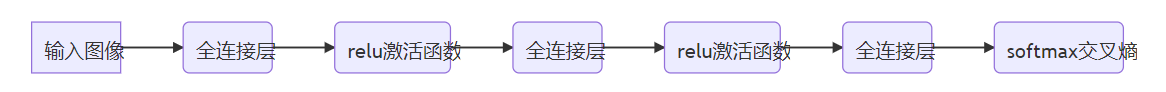

一个完整的神经网络通常由多个基本的网络层堆叠而成。本实验中的三层神经网络由三个全连接层构成,在每两个全连接层之间会插入ReLU激活函数引入非线性变换,最后使用Softmax层计算交叉嫡损失,如图所示:

三种基本网络层介绍如下:

全连接层:

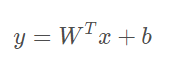

全连接层以一维向量作为输入,输入与权重相乘后再与偏置相加得到输出向量。假设全连接层的输入为一维向量x,维度为m;输出为一维向量y,维度为n;权重W是二维矩阵,维度为mxn,偏置b是一维向量,维度为n。前向传播时,全连接层的输出的计算公式:

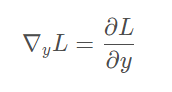

在计算全连接层的反向传播时,给定神经网络损失函数L对当前全连接层的输出y的偏导:

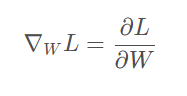

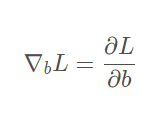

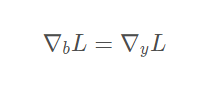

其维度与全连接层的输出y相同,均为n。根据链式法则,全连接层的权重和偏置的梯度:

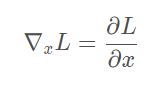

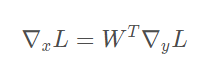

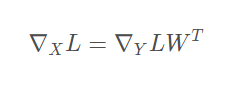

以及损失函数对输入的偏导:

计算公式分别为:

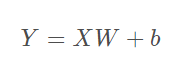

实际应用中通常使用批量随机梯度下降算法进行反向传播计算,即选择若干个样本同时计算。假设选择的样本量为p,此时输入变为二维矩阵X,维度为p×m,每行代表一个样本。输出也变为二维矩阵Y,维度为p×n。此时全连接层的前向传播计算公式为:

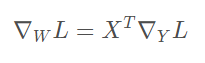

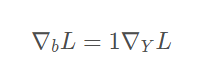

其中的+代表广播运算,表示偏置b中的元素会被加到XW的乘积矩阵对应的一行元素中。权重和偏置的梯度以及损失函数对输入的偏导的计算公式变为:

其中计算偏置的梯度时,为确保维度正确,用与维度为1×p的全1向量1相乘。

激活函数层:

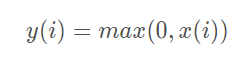

ReLU激活函数是按元素运算操作,输出向量y的维度与输入向量x的维度相同。在前向传播中,如果输入x中的元素小于0,输出为0,否则输出等于输入。因此ReLU的计算公式为:

其中x(i) 和y(i)分别代表x和y在位置i的值。

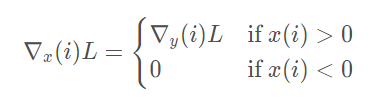

由于ReLU激活函数不包含参数,在反向传播计算过程中仅需根据损失函数对输出的偏导计算损失函数对输入的偏导。设i代表输入x的某个位置,则损失函数对本层的第i个输入的偏导的计算公式为:

softmax激活层:

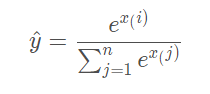

Softmax损失层是目前多分类问题中最常用的损失函数层。假设Softmax 损失层的输入为向量x,维度为k。其中k对应分类的类别数,如对手写数字0至9进行分类时,类别数k = 10。在前向传播的计算过程中,对r计算e指数并进行归一化,即得到Softmax分类概率。假设x对应 i位置的值为x(i),y^(i)为i位置的Softmax 分类概率,i ∈[1,k]且为整数,则到y^(i)的计算公式为:

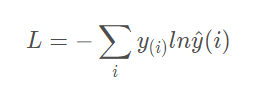

在前向计算时,对Softmax 分类概率,取最大概率对应的类别作为预测的分类类别。损失层在计算前向传播时还需要根据给定的标记(label,也称为真实值或实际值)y计算总的损失函数值。在分类任务中,标记y通常表示为一个维度为k的one-hot向量,该向量中对应真实类别的分量值为1,其他值为0。Softmax损失层使用交叉嫡计算损失值,其损失值L的计算公式为:

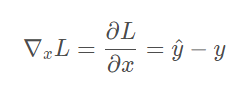

在反向传播的计算过程中,可直接利用标记数据和损失层的输出计算本层输入的损失。对于Softmax损失层,损失函数对输入的偏导vxL的计算公式为:

由于工程实现中使用批量随机梯度下降算法,假设选择的样本量为p,Softmax 损失层的输入变为二维矩阵X,维度为p×k,的每个行向量代表一个样本,则对每个输入计算e指数并进行行归一化得到:

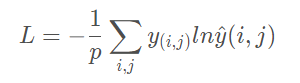

在前向计算时,对Softmax分类概率的每个样本(即每个行向量)取最大概率对应的类别作为预测的分类类别。此时标记Y通常表示为一组one-hot向量,维度为p×k,其中每行是一个one-hot向量,对应一个样本的标记。则计算损失值的公式变为:

其中损失值是所有样本的平均损失,因此对样本数量p取平均。

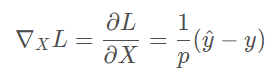

在反向传播时,当选择的样本量为p时,损失函数对输入的偏导的计算公式变为:

类似地,损失vxL是所有样本的平均损失,因此对样本数量p取平均。

热门帖子

精华帖子