打开微信,使用扫一扫进入页面后,点击右上角菜单,

点击“发送给朋友”或“分享到朋友圈”完成分享

视频: https://space.bilibili.com/555233120

博文: https://www.zhihu.com/column/c_153105552906083123

代码: https://gitee.com/yifanrensheng/deep_learning_for_cv

文章概述:主要介绍神经网络及神经网络的重要组成,重点介绍正向传播,反向传播的数学推到,以及损失函数的意义。从代码层面介绍了如何搭建一个简单的神经网络。

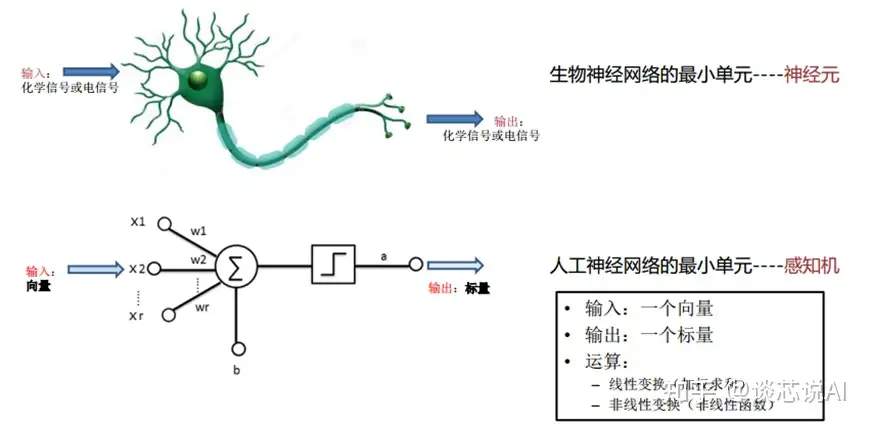

大脑是由处理信息的神经元细胞和连接神经元的细胞进行信息传递的突触构成的。树突(Dendrites)从一个神经元接受电信号,信号在细胞核(Cell Body)处理后,然后通过轴突(Axon)将处理的信号传递给下一个神经元。

计算机处理信息类比为输入向量,通过加权求值线性得出,再经过非线性变换输出一个标量。如下图所示:

神经网络的变种目前有很多,如误差反向传播(Back Propagation,BP)神经网路、概率神经网络、卷积神经网络(Convolutional Neural Network ,CNN-适用于图像识别)、长短记忆神经网络(Long short-term Memory Network ,LSTM-适用于语音识别),Attention类网络等。

神经网络中最简单的则是MLP(Multi- Perception ,多层感知器)

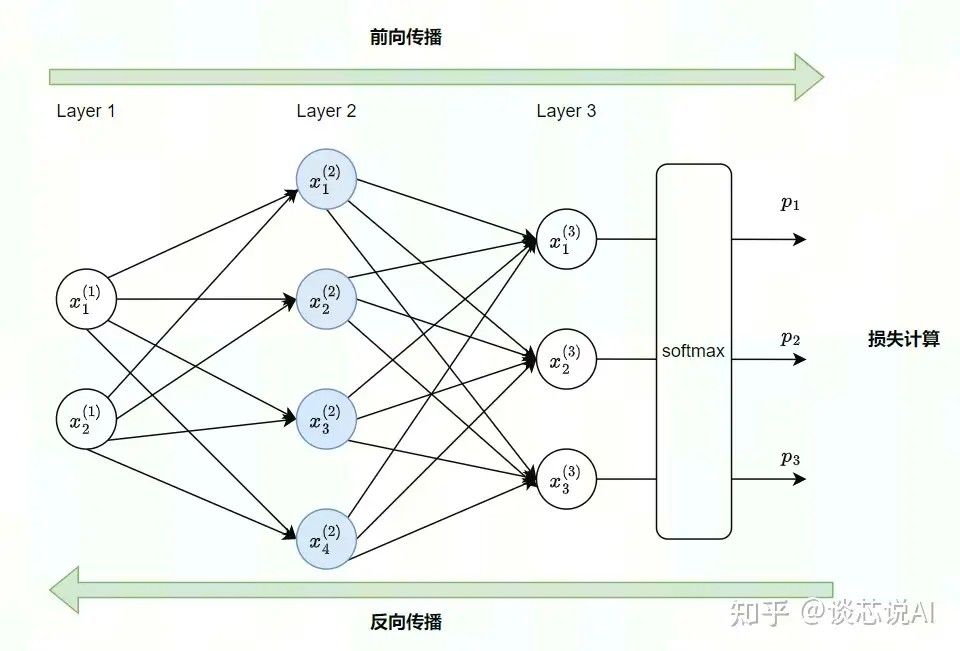

多层感知机是人工神经网络的一种最简单形式,除了输入输出层,它中间可以有多个隐层,最简单的MLP只含一个隐层,即三层的网络结构。如下图所示:

其中比较重要的部分为:前向传播,损失计算和反向传播。

举例:

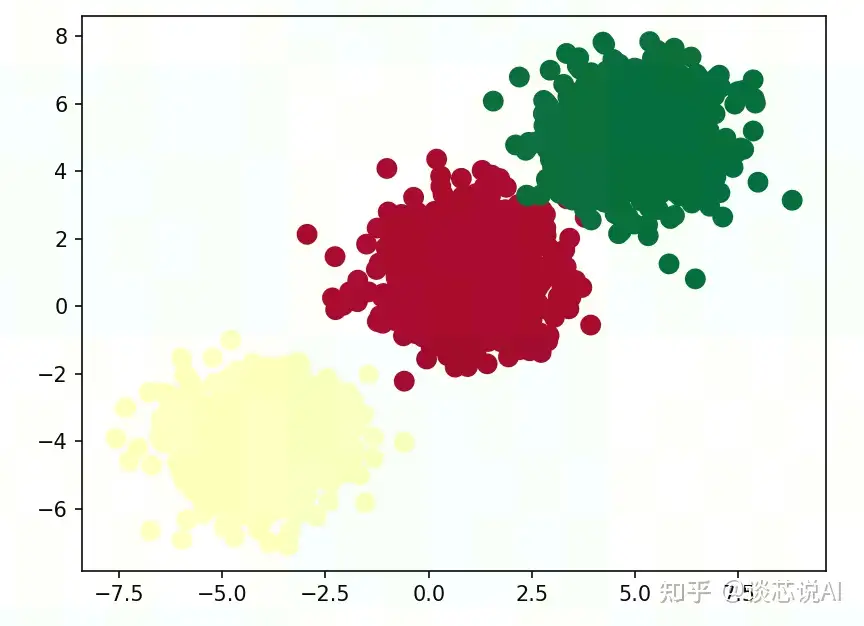

结合上图,假设要对以下2维数据使用神经网络分类,这里分为三类。

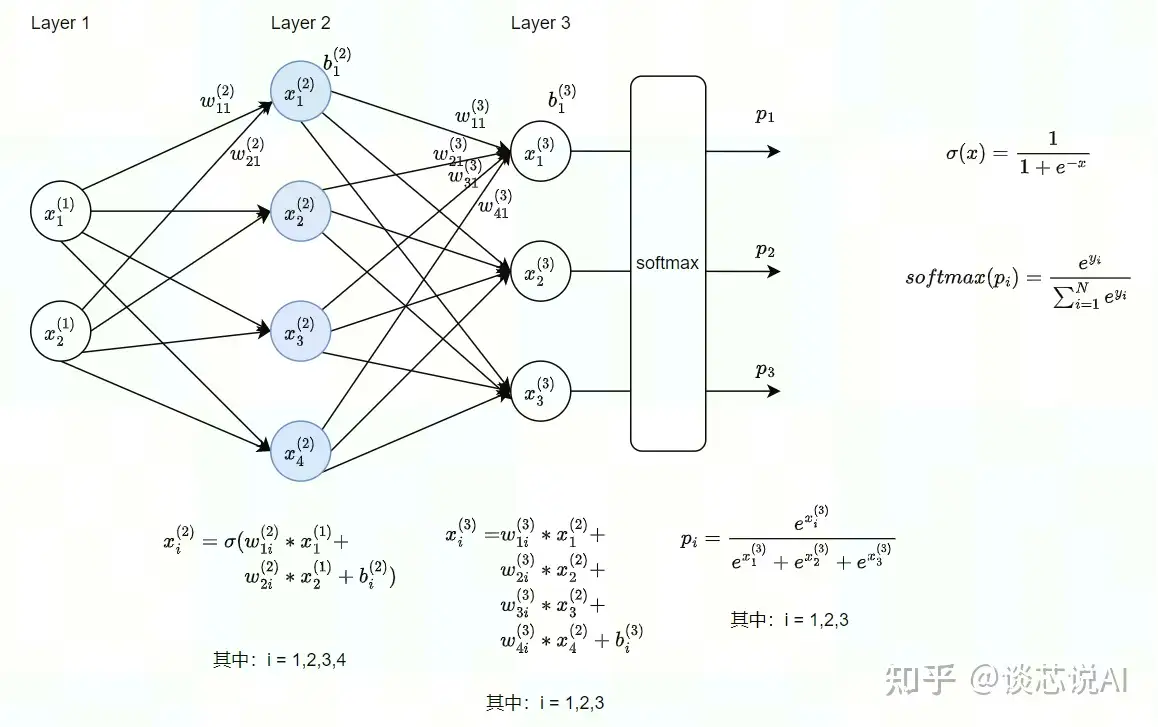

前向计算过程中,主要包含中间 2层(乘法,加法和激活函数)和 3(乘法,加法)层的计算,

可以使用矩阵法则比较的简洁。将上面的例子一般化,并写成矩阵乘法的形式:

另外上式子中使用了激活函数,常见的有 Sigmoid,ReLU,PReLU 等,这里使用了sigmoid。表达式如上图所示。

热门帖子

精华帖子